Dynamiczny rozwój globalnej sieci komputerowej internet w ostatnich latach miał niewątpliwie wpływ na wiele obszarów naszego życia, a zmiany towarzyszące jej wszechobecnej ekspansji dotknęły w jakimś stopniu wszystkie grupy społeczne. Za szczególną grupę użytkowników internetu należy uznać dzieci, czyli osoby w wieku poniżej 18. roku życia, które mogą nie do końca umieć ocenić sytuacje, z którymi spotykają się online.

PROBLEM

Nieograniczonej niemalże wymianie treści w wirtualnym świecie towarzyszą różnego rodzaju zagrożenia, na które dzieci – z uwagi na kształtującą się dopiero dojrzałość – są wyjątkowo podatne. Do występujących w cyberprzestrzeni zagrożeń o największym ciężarze gatunkowym należy seksualne wykorzystywanie nieletnich, czyli forma kontaktu seksualnego typowa dla repertuaru doświadczeń osób dorosłych, na którą dziecko nie ma wystarczającej gotowości rozwojowej, pozwalającej na udźwignięcie jej ciężaru gatunkowego bez szkody dla dalszego rozwoju seksualnego1.

Technologia, która stała się nieodłączną częścią naszego życia, spowodowała, że wiele zjawisk pojawiających się w realnym świecie przeniosło się do świata wirtualnego. Dzieci są w nim ofiarami seksualnego wykorzystywania na wiele sposobów: ich fizycznemu wykorzystywaniu towarzyszą produkcja i dystrybucja materiałów dokumentujących te sytuacje, włączając w to tzw. live streaming, czyli przekaz polegający na transmisji fizycznego wykorzystywania dziecka drogą online, adresowany do zainteresowanych odbiorców, którzy taki przekaz opłacili. Dzieci są uwodzone, zastraszane, a nawet szantażowane w celu uzyskania nowych materiałów, będących swoistego rodzaju walutą wśród seksualnie nimi zainteresowanych dorosłych.

Skala tego zjawiska jest niestety ogromna. Z uwagi na jego złożoność trudno tu o dokładne dane, można jedynie opierać się na informacjach przekazywanych przez wyspecjalizowane w tym obszarze organizacje i instytucje. Jedną z nich jest National Center for Missing & Exploited Children2, amerykańska organizacja, posiadająca w swoich strukturach CyberTipline, czyli hotline zrzeszoną w stowarzyszeniu INHOPE3. Z uwagi na wyjątkową regulację amerykańskiego prawa federalnego lokalne podmioty sektora prywatnego mają obowiązek raportowania do CyberTipline przypadków ujawnienia w ich zasobach materiałów mogących przedstawiać seksualnie wykorzystywane dzieci (Child Sexual Abuse Material – CSAM). Liczby publikowane przez tę organizację są porażające: w 2020 r. CyberTipline otrzymała ponad 21,7 mln raportów, co stanowi 28-procentowy przyrost w porównaniu z rokiem 20194.

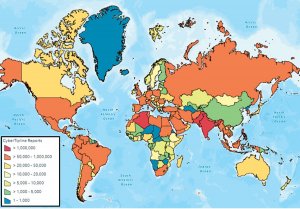

Zamieszczona na kolejnej stronie mapa przedstawia 21,7 mln raportów podzielonych na kraje świata. Podział ten został dokonany według geograficznych wskazówek nawiązujących m.in. do lokalizacji, gdzie był transfer pliku (upload), choć należy również uwzględnić błędy w tych danych spowodowane użyciem technik proxy lub anonimizujących. Zgodnie z tymi danymi w 2019 r. do Polski przekierowano 77 741 raportów CyberTipline oraz 381 254 raporty w roku 20205.

Wniosek, który można sformułować na podstawie dostępnych danych, jest prosty: skuteczne zwalczanie seksualnego wykorzystywania dzieci w dzisiejszym świecie i zapobieganie temu zjawisku nie są możliwe bez zastosowania zautomatyzowanych technologii. Te z nich, które można użyć – w dużym uproszczeniu – dzielimy na trzy grupy: najbardziej podstawową – File Hashing, średniozaawansowaną – Computer Vision oraz najbardziej innowacyjną – Artificial Intelligence6.

O aktualnych trendach dotyczących zjawiska seksualnego wykorzystywania dzieci w cyberprzestrzeni można dowiedzieć się więcej z tematycznych raportów7, publikowanych np. przez Europejskie Centrum ds. Zwalczania Cyberprzestępczości (EC3 – Europol8). Uważny czytelnik szybko dostrzeże, że występuje w nich podział na trendy dotyczące treści (content, np. zdjęcia czy filmy wideo) oraz zachowania (behaviour, np. uwodzenie).

ROZWIĄZANIA TECHNOLOGICZNE NAWIĄZUJĄCE DO TREŚCI (CSAM)

Badania w tym obszarze udowodniły, że dystrybucja materiałów określanych jako CSAM drogą cyfrową pogłębia wiktymizację prezentowanych na nich ofiar i ma na nie długotrwały, szkodliwy wpływ, nawet wtedy, gdy są to już osoby dorosłe. Eksperci szacują, że jedno zdjęcie seksualnie wykorzystywanego dziecka może być udostępniane nawet 70 000 razy lub więcej. Dlatego tak ważne jest dwutorowe działanie polegające na użyciu materiałów dostępnych w internecie w celu dotarcia do dziecka będącego w rzeczywistym czasie ofiarą seksualnego wykorzystywania (rola organów ścigania) oraz usuwanie tego typu materiałów z tej sieci (rola hotlines, zrzeszonych w INHOPE, np. Zespołu Dyżurnet.pl, działającego w strukturach Naukowej i Akademickiej Sieci Komputerowej NASK PIB, oraz sektora prywatnego). Liczba materiałów z kategorii CSAM dostępnych aktualnie w internecie jest wyzwaniem dla wszystkich organów ścigania, niezależnie od ich lokalizacji geograficznej, a także organizacji, takich jak Dyżurnet.pl.

Jednym z najbardziej popularnych rozwiązań w tym obszarze są działania polegające na wykorzystaniu File Hashing oraz Computer Vision do szybkiej weryfikacji, czy dany plik może zostać zakwalifikowany jako CSAM. Możliwość dokonania takich ustaleń jest niezwykle cenna dla wielu podmiotów zaangażowanych w walkę z tego typu treściami. Policjant, który w ramach prowadzonego postępowania ma do czynienia z nowym zbiorem zabezpieczonych materiałów cyfrowych, może szybko ustalić, czy są w nim pliki z kategorii CSAM. W drugiej kolejności taka weryfikacja pozwala na ustalenie, czy ma do czynienia z materiałem nowym, wskazującym na możliwość seksualnego wykorzystywania dziecka w rzeczywistym czasie.

Kolejnym krokiem jest współpraca w ramach bazy danych ICSE9, będącej w zasobach Interpolu10. To dzięki niej wyspecjalizowane jednostki organów ścigania w państwach członkowskich tej organizacji mogą dokonywać weryfikacji zabezpieczonych materiałów i wymieniać się informacjami na ich temat ze swoimi odpowiednikami na całym świecie. Podobna korzyść będzie dotyczyła analityka zatrudnionego np. w Dyżurnet.pl, który nie będzie musiał oglądać po raz kolejny tego samego zdjęcia, aby je właściwie zakwalifikować.

Podstawowym warunkiem skuteczności takich rozwiązań jest istnienie wiarygodnych baz referencyjnych – dane hash11 nowego nieznanego pliku są porównywane ze zbiorem danych plików zakwalifikowanych wcześniej jako CSAM przez wyszkolonego do tego policjanta lub analityka. Rozwiązania oparte na przywołanych tutaj technologiach są już wykorzystywane przez organy ścigania, które w swoich zasobach mają krajowe bazy danych materiałów CSAM (np. Szwecja), przez Interpol (baza danych ICSE), jak również niektóre hotlines, np. Cyber-Tipline – Stany Zjednoczone, Cybertip – Kanada12, Internet Watch Foundation – Wielka Brytania13 oraz, od niedawna, także Meldpunt Kinderporno – Holandia14. Właśnie temu ostatniemu rozwiązaniu warto przyjrzeć się bliżej z uwagi na fakt, że nadaje się ono do łatwej adaptacji w innych warunkach.

HASH CHECK SERVICE (HCS)

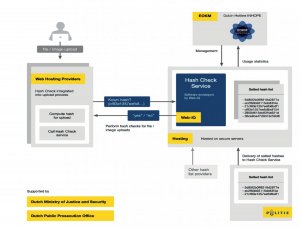

Zamieszczony powyżej rys. 2. przedstawia schemat wymiany danych hash, odbywającej się między trzema środowiskami: policją, hotline oraz dostarczycielami usług hostingowych, którzy chcą sprawdzić pliki transferowane do ich zasobów. W warunkach holenderskich za zarządzanie HCS odpowiada EOKM, czyli organizacja mająca w swoich strukturach hotline, która otrzymuje dane hash od krajowej policji. Generuje je samodzielnie, w procesie klasyfikacji materiałów zgłoszonych do niej jako potencjalnie nielegalne, jak również korzysta z innych list danych hash, udostępnianych na poziomie międzynarodowym. Weryfikacja (cross check) danych z HCS polega na skierowaniu do niego zapytania: „Czy dane hash są znane/występują w bazie danych hash HCS”, na które zostaje udzielona odpowiedź twierdząca lub przecząca.

APAKT, AVIATOR i GRACE

Funkcjonowanie HCS opiera się na porównaniu nieznanego pliku (cross check) z materiałami wcześniej sklasyfikowanymi jako CSAM. Wyzwaniem pozostaje jednak niezmiennie możliwość identyfikowania takich materiałów w dużych zbiorach nieskwalifikowanych wcześniej plików. Tutaj również na pomoc przychodzi technologia, oparta na najbardziej innowacyjnym z przywołanych rozwiązań – Artificial Intelligence.

Aktualnie w NASK PIB jest realizowany projekt APAKT15, w ramach którego zostanie stworzony system służący do analizy zagrożeń związanych z propagowaniem nielegalnych i wrażliwych treści w cyberprzestrzeni z wykorzystaniem automatycznie tworzonych modeli ich klasyfikacji, zbudowanych przy zastosowaniu nowoczesnych technik sztucznej inteligencji i rozpoznawania wzorców. Podobne wykorzystanie Artificial Intelligence wdraża również brytyjska hotline, IWF16.

Z tej grupy rozwiązań należy przywołać jeszcze dwa projekty: funkcjonujący już AviaTor17 oraz będący w fazie początkowej Grace18. Augumented Visual Intelligence and Targeted Online Research (AviaTor) ma za zadanie pomagać organom ścigania w nadawaniu właściwego priorytetu raportom otrzymywanym z NCMEC. Właściwe wykorzystanie tych raportów jest aktualnie wyzwaniem dla wielu organów ścigania, w którym chodzi o to, aby z setek tysięcy takich dokumentów wyszukać te, które mogą dotyczyć wykorzystania seksualnego dziecka odbywającego się w rzeczywistym czasie i nadać im właściwy priorytet. Narzędzia tego projektu, finansowanego z funduszy unijnych (Internal Security Fund – Police), zostały wypracowane z udziałem przedstawicieli policji i są dostępne bezkosztowo dla zainteresowanych formacji policyjnych, które do tej pory były zmuszone do stosowania krótkotrwałych, doraźnych rozwiązań. W policji holenderskiej AviaTor funkcjonuje już od 2019 r.

Projekt Grace (z udziałem polskiej Policji), którego wdrażanie jest finansowane z budżetu Komisji Europejskiej (Research and Innovation) i przewidziane na lata 2020–2023, zakłada dostarczenie europejskiej platformy współpracy organów ścigania, dzięki której będą dostępne zaawansowane narzędzia cyfrowe i analityczne, mające wesprzeć zasoby śledcze w tych organach i ich odpowiedź na zjawisko seksualnego wykorzystywania dzieci w cyberprzestrzeni19.

ROZWIĄZANIA TECHNOLOGICZNE

Na uwagę zasługuje rozwiązanie technologiczne, którego celem jest identyfikowanie adresowanych do dzieci zachowań online, mających podłoże seksualne oraz mogących wyczerpywać znamiona czynu zabronionego, takiego jak online grooming, czyli uwodzenie online. Mowa o technologii określanej jako anti-grooming tool, opracowywanej od końca 2018 r., opierającej się na patencie Microsoft20 i od stycznia 2020 r. przekazanej do dalszego wykorzystywania (w zakresie licencji i udostępniania) organizacji Thorn21. Rozwiązanie to polega na wykorzystaniu Artificial Intelligence do skanowania historycznych zapisów rozmów tekstowych w celu monitorowania możliwości wystąpienia groomingu oraz, w przypadku zidentyfikowania takiego zachowania, jak najszybszego powiadomienia o tym organów ścigania.

W praktyce rozwiązanie to dokonuje ewaluacji i oceny rozmowy online na podstawie jej cech charakterystycznych, nadając jej ogólną ocenę prawdopodobieństwa. Wyróżniona konwersacja jest następnie przekazywana moderatorowi, który dokonuje jej przeglądu, głównie pod kątem wystąpienia realnego zagrożenia dla ofiary.

Anti-grooming tool to kolejny doskonały przykład współpracy człowieka z technologią, potwierdzający tezę, zgodnie z którą dzisiejsze skuteczne zapobieganie seksualnemu wykorzystywaniu dzieci w cyberprzestrzeni i zwalczanie go wymagają nadążania za ciągłym rozwojem technologii i adaptowania jej osiągnięć do tych celów. Wyścig o technologię z przestępcami trwa. Przypadek funkcjonowania Dark web oraz Darknet22 pokazuje, że są oni w tym obszarze niezwykle skuteczni, dlatego tak ważna jest współpraca międzynarodowa, a zwłaszcza dialog organów ścigania z sektorem prywatnym, głównym dostarczycielem rozwiązań technologicznych. Niedawna decyzja koncernu Apple23 o wdrożeniu rozwiązania polegającego na wykrywaniu znanych materiałów z kategorii CSAM przechowywanych w iCloud Photos jest najlepszym dowodem na to, że czasami ten dialog zmierza w dobrą stronę.

podinsp. w st. spocz. KATARZYNA STACIWA

samodzielny specjalista Zespołu Dyżurnet.pl

1 Stanowisko większości badaczy i klinicystów zaprezentowane m.in. w: M. Beisert, A. Izdebska, Wykorzystanie seksualne dzieci, „Dziecko Krzywdzone” 2012, nr 2 (39), s. 48.

2 National Center for Missing & Exploited Children (NCMEC)

– prywatna organizacja non-profit, której misją jest niesienie pomocy w poszukiwaniu zaginionych dzieci, jak również ograniczenie zjawiska ich seksualnego wykorzystywania, https://www.missingkids.org/theissues/csam.

3 International Association of Internet Hotlines (INHOPE) – organizacja składająca się obecnie z 47 hotlines, działających w 43 krajach. Każda hotline udostępnia mechanizm anonimowego raportowania online przypadków ujawnienia nielegalnych materiałów, ze szczególnym uwzględnieniem CSAM, https://inhope.org/.

4 https://www.missingkids.org/gethelpnow/cybertipline.

5 Ibidem, 2019&2020 Reports by Country.

6 Więcej informacji na ten temat można znaleźć w publikacji „Respecting human rights and the rule of law when using automated technology to detect online child sexual exploitation and abuse”, dostępnej na stronie internetowej Rady Europy: https://rm.coe.int/respecting-human-rights-and-the-rule-of-law-when-using-automated-techn/1680a2f5ee. Autorka znalazła się

w gronie ekspertów zaproszonych do opracowania tego dokumentu, jak również pełniła funkcję koordynatora tego projektu, https://www.coe.int/en/web/children/-/public-launch-of-the-report-on-the-use-of-automated-technology-to-detect-online-child-sexual, exploitation-and-abuse.

7 Internet Organised Crime Threat Assessment (IOCTA).

– flagowy produkt strategiczny jednego z Dyrektoriatów Agencji Unii Europejskiej ds. Współpracy Organów Ścigania – Europol, odpowiedzialnego za zwalczanie cyberprzestępczości – European Cybercrime Centre (EC3), https://www.europol.europa.eu/activities-services/main-reports/internet-organised-crime-threat-assessment#fndtn-tabs-0-bottom-1.

8 European Cybercrime Centre (EC3) – powołany w 2013 r., odrębny Dyrektoriat Europolu, którego zadaniem jest zwalczanie cyberprzestępczości. Podobnie jak cały Europol, ma siedzibę w Holandii, w Hadze, https://www.europol.europa.eu/about-europol/european-cybercrime-centre-ec3.

9 International Child Sexual Exploitation (ICSE) Database – to baza zdjęć i filmów wideo, umożliwiająca współpracę wyspecjalizowanych organów ścigania z ponad 60 krajów, polegającą na wymianie informacji kryminalnych dotyczących zdarzeń z udziałem seksualnie wykorzystywanych dzieci. Dzięki tej współpracy organy ścigania unikają dublowania wysiłków; mogą szybko weryfikować, czy seria zdjęć została już ujawniona i zidentyfikowana w innym kraju albo czy posiada ona podobne do innych zdjęć cechy. ICSE DB zawiera ponad 2,7 mln zdjęć i filmów wideo i pomogła w identyfikacji około 23 500 dzieci – ofiar seksualnego wykorzystywania na całym świecie, https://www.interpol.int/Crimes/Crimes-against-children/International-Child-Sexual-Exploitation-database.

10 INTERPOL (International Criminal Police Organization) – to międzynarodowa organizacja zrzeszająca organy ścigania ze 194 krajów. Jej Sekretariat Generalny ma siedzibę we Francji, w Lyonie, https://www.interpol.int/.

11 Inaczej „cyfrowy podpis” danego pliku, który koresponduje z jego zawartością, np. 3CBCFDDEC145E3382D592266BE193E5BE53443138EE6AB6CA09FF20DF609E268, https://docs.microsoft.com/en-us/powershell/module/microsoft.powershell.utility/get-filehash?view=powershell-7.1 oraz https://pl.wikipedia.org/wiki/Funkcja_skr%C3%B3tu.

12 Cybertip funkcjonuje w strukturach Canadian Centre for Child Protection, https://www.cybertip.ca/app/en/. Centrum to wdraża również projekt Arachnid, którego głównym produktem jest automatyczny crawler (program komputerowy używany przez wyszukiwarki internetowe, służący do automatycznego odnajdywania oraz odczytywania zawartości i indeksowania stron internetowych w całej sieci – przyp. red.), wykrywający CSAM na podstawie danych hash i wysyłający powiadomienie do dostarczyciela usług hostingowych, w którego zasobach taki materiał się znajduje, https://projectarachnid.ca/en/.

13 Internet Watch Foundation (IWF), https://www.iwf.org.uk/ oraz https://www.iwf.org.uk/intelligrade.

14 Meldpunt Kinderporno funkcjonuje w strukturach Expertisebureau Online Kindermisbruik, https://www.meldpunt-kinderporno.nl/over-ons/hash-database/.

15 Projekt ten jest realizowany przez Zespół Dyżurnet.pl wspólnie z przedstawicielami Politechniki Warszawskiej oraz firmy ENAMOR International, https://www.nask.pl/pl/dzialalnosc/nauka-i-biznes/projekty-badawcze/4100,System-reagujacy-na-zagrozenia-bezpieczenstwa-dzieci-w-cyberprzestrzeni-ze-szcze.html.

16 https://annualreport2020.iwf.org.uk/tech/new/classifiers oraz https://www.blog.google/around-the-globe/google-europe/using-ai-help-organizations-detect-and-report-child-sexual-abuse-material-online/.

17 https://www.inhope.org/EN/aviator oraz https://www.inhope.org/EN/articles/law-enforcement-test-ai-tool-aviator.

18 https://www.grace-fct.eu/.

19 https://www.grace-fct.eu/sites/default/files/2021-08/GRACE%20Newsletter%20-%20June%202021_1.pdf.

20 https://blogs.microsoft.com/on-the-issues/2020/01/09/artemis-online-grooming-detection/ oraz https://www.thorn.org/blog/what-is-project-artemis-thorn-microsoft-grooming/.

21 Thorn – międzynarodowa organizacja o amerykańskich korzeniach, zajmująca się zjawiskiem wykorzystywania seksualnego dzieci, https://www.thorn.org/.

22 Dark web – to w dużym uproszczeniu ukryta część zasobów internetu, którą można przeglądać za pomocą specjalnego oprogramowania. Natomiast Darknet to sieci o ograniczonym dostępie, składające się z wielu rozproszonych, anonimowych węzłów (takich jak Tor, I2P czy Freenet) umożliwiających wejście do Dark web.

23 https://www.apple.com/child-safety/.